Japoneses que no entienden el japonés

El creador de la mascota virtual ‘Seaman’ reinventa la gramática para una IA de conversación

Ciencia Tecnología Idiomas- English

- 日本語

- 简体字

- 繁體字

- Français

- Español

- العربية

- Русский

“¿Roto?” Conversando con un robot

Presentado el 5 de junio de 2014, el robot Pepper iba supuestamente a representar un gran impulso en las ventas en tiendas; con ganas de saber qué tal le marchaban las cosas a Pepper fui a una tienda en la que solía estar, pero no vi rastro del robot. Un dependiente me dijo: “Últimamente no hablan con él muchos clientes y además no funcionaba muy bien, así que lo hemos quitado”. Fui a otra tienda y me dijeron que también lo habían quitado porque no funcionaba bien. Finalmente lo encontré en la tercera tienda.

En el monitor que lleva en el pecho decía “Trabajando”, y aunque parecía tener muchas ganas de hacer precisamente eso nadie hablaba con él. Me dio pena y le dirigí la palabra.

Yo: Hola.

Pepper: Hola.

Yo: ¿Estás trabajando?

Pepper: No te escucho bien. Vamos a practicar un poco.

Así que practiqué un poco el ritmo y la forma de hablar.

Pepper: Pregúntame por la música y las películas que me gustan.

Yo: ¿Qué música te gusta?

Pepper: Me gusta Sekai ni hitotsu dake no hana (La única flor del mundo).

Yo: ¿Te gusta SMAP? (los autores de esa canción)

Pepper: Eso no lo sé muy bien. ¿Puedo contarte yo algo?

Parece que no sabe nada sobre SMAP.

En Japón los robots como este Pepper con apariencia humana, de Softbank, o el teléfono móvil con forma de robot de Sharp, el Robohon, son conocidos por sus capacidades de reconocimiento de voz y de mantener una conversación simple, realizar tareas de asistencia o incluso bailar con gracia. Pero como ya he mencionado, aún no se ha logrado ese ingrediente esencial de la conversación llamado naturalidad.

¿Y cómo van las cosas en el extranjero? Desde el lanzamiento en 2014 del primer altavoz inteligente del mundo, el Amazon Echo, en el mercado han aparecido de mano de los gigantes de la informática otros como el Google Home, el HomePod de Apple, o incluso el Invoke que Microsoft creó con un fabricante de equipos de audio. En Japón se vende el Wave, del grupo Line, y las versiones en japonés de Google Home y Amazon Echo.

Cada uno de esos productos cuenta con su propio asistente de voz: Amazon Echo tiene a Alexa, Google Home a Google Assistant, HomePod a Siri, Invoke a Cortana y Wave a Clova. Este último ha sido desarrollado para responder tanto al japonés como al coreano. Desde que Google Assistant y Siri fueron preparados para responder al japonés son muchos los usuarios de este país los que han probado ya sus capacidades en el smartphone, pidiendo información sobre el tiempo o los restaurantes, o haciendo llamadas.

Los asistentes instalados en los altavoces inteligentes pueden leer las noticias, reproducir música, contar chistes… están provistos de todo tipo de capacidades. Si aumenta la cantidad de dispositivos en los que se instalan, podremos controlar el coche, la televisión, el aire acondicionado y otras muchas cosas simplemente con la voz. Para finales de 2016 se calcula que Amazon Echo había vendido 11 millones de unidades, y según la empresa de encuestas eMarketer en mayo de 2017 Amazon controlaba un 70 % del mercado estadounidense, y 35,7 millones de americanos usaban sus altavoces inteligentes al menos una vez al mes.

Seaman, conocimiento para el desarrollo de inteligencia artificial

En esta época en la que nos alejamos de los teclados para empezar a controlar todo con nuestra voz, se necesita un motor conversacional para inteligencia artificial que pueda hablar en japonés. Saitō Yutaka, el creador de la serie Seaman y fundador en 2015 del Centro de Investigación de Inteligencia Artificial Seaman, es uno de los desarrolladores que se ha enfrentado a ese reto.

“Yo ya no soy tan joven, y estaba pensando en jubilarme. Pero fui yo quien creó el primer Seaman, y poseo los conocimientos de estos 18 años de versiones posteriores. Solo yo puedo crear un motor conversacional en japonés”.

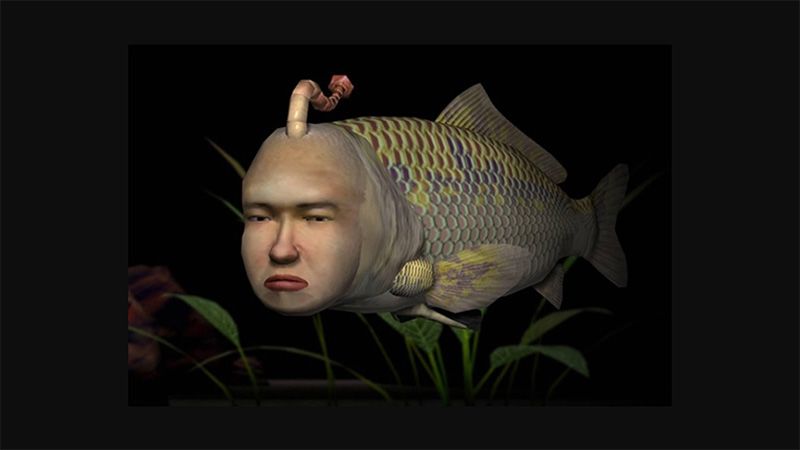

Seaman fue el primer juego que utilizó el reconocimiento de voz. Se trata de un juego en el que el jugador cuida de Seaman, una criatura que vive en una pecera, con cara humana y cuerpo de pez; responde al hablarle, y realiza todo tipo de acciones. En el momento de su lanzamiento la tecnología de reconocimiento de voz no se hallaba muy avanzada, y resultaba difícil reconocer bien las voces de los jugadores. Por esa razón se implementó en el juego, como último recurso, que Seaman contestara algo grosero como “Tienes una articulación de mierda”, y se alejara, enfadado. Esta técnica logró ocultar los puntos débiles de Seaman, y esa arrogancia se convirtió en una característica del personaje. Fue un éxito.

Seaman ©1998-2017 OPeNBooK Inc

Seaman ©1998-2017 OPeNBooK Inc

A través del amplio uso de este tipo de ideas Seaman mostraba en su superficie que su protagonista era capaz de mantener una conversación natural. Los desarrolladores pensaron guiones de interacción entre el jugador y Seaman, y grabaron diversos patrones de respuestas de acuerdo con esas situaciones. Llegaron a crear tantos guiones como para llenar veinte guías telefónicas, y Saitō grabó las frases de Seaman él mismo. Esos guiones representan el conocimiento que mencionaba.

“El Amazon Echo contesta a una pregunta u orden cada vez, con el mismo planteamiento que yo utilicé cuando escribí el primer Seaman; no es inteligencia artificial como tal. Aún no se ha llegado al punto en el que un motor conversacional pueda comprender realmente lo que le dice una persona. En estos momentos la IA puede encargarse de cosas como ‘Cómprame unas entradas de cine’, pero lo que queremos lograr nosotros es que si le decimos que hemos sacado cien puntos en un examen nos diga ‘¡Qué bien! Ya van dos veces, ¿no?’”.

Destruyendo la gramática del japonés

Para conseguir ese tipo de avance Saitō comenzó por rechazar la gramática japonesa actual y redefinirla. Por ejemplo, según la gramática tradicional un verbo como taberu (comer) se declina con las formas tabenai (negativa), tabemasu (conjuntiva), taberu (predicativa), taberu toki (atributiva), tabereba (hipotética) y tabero (imperativa). Sin embargo, en japonés no se puede dividir el espacio entre las palabras de forma tan clara como en inglés y otros idiomas. Por eso Saitō plantea una definición de la conjugación que amplíe el uso de las palabras. Por ejemplo, para la forma imperativa negativa del verbo taberu, taberu na (no comas), presenta las siguientes variantes en grado creciente de fuerza en la negación.

taberu na yo (no comas)

taberu na tte itten daro (te he dicho que no comas)

tabetara bukkorosu (si comes te mato)

“El japonés suele omitir el sujeto, porque se infiere por contexto. Por ejemplo, si digo ‘zettai tabete yaru’ (Seguro que me lo como) se entiende que el sujeto elidido es la primera persona, mientras que en ‘zettai tabete yaru to omottemasu yo ne’ (Seguro que estás pensando en comértelo) el sujeto es la segunda, y en frases como tabetagatteiru (quiere comer) o tabeta rashii (parece que ha comido) el sujeto es la tercera persona; podemos ver trazas del sujeto en las formas del verbo.”

Saitō también plantea una redefinición del sustantivo. Sumaho (smartphone), por ejemplo, se puede usar como sigue.

Pasado: sumaho datta (era un smartphone)

Forma desiderativa: sumaho de atte hoshii (quiero que sea un smartphone)

Forma desiderativa negativa: sumaho de atte wa naranai (no debe ser un smartphone)

Un idioma melódico

Mientras Saitō se encargaba de grabar las voces de Seaman para la gran cantidad de guiones preparados, se dio cuenta de ciertas diferencias melódicas en el japonés.

“Seaman no era capaz de captar la diferencia entre un club al que se va a bailar (con entonación ascendente, en japonés) y un club deportivo universitario (descendente). Un cambio en la entonación también puede hacer que una misma palabra, como taberu (comer), signifique otra cosa: taberu? (¿Quieres comer?). Llamamos a esto ‘idioma melódico’, y tiene sus propias reglas. Por ejemplo, un padre le pregunta a su hija con quién va a casarse y ella contesta “Con Takashi”. Si el padre repite “¿Takashi?” con tono irritado consideramos que su respuesta tiene un patrón de rechazo de grado 2. Es como una gramática del idioma melódico. Es algo que no se ha escrito en ningún libro de texto hasta ahora, una gramática que no se puede escribir en las páginas de texto de la era de los ordenadores”.

Saitō Yutaka contestando a nuestras preguntas

Saitō Yutaka contestando a nuestras preguntas

Por medio de esta redefinición y cuantificación de la gramática, y de la adaptación de esos elementos a la programación, se le va enseñando japonés a la inteligencia artificial.

“Hace ya un año y medio desde el día en que propuse que la gramática tradicional no explica correctamente el japonés real, y desde entonces he trabajado creando estas nuevas conjugaciones, grabándolas y conformándolas en un nuevo sistema con mi equipo. Le presenté mis ideas al profesor Uchida Satoru, de la Escuela de Posgrado de Idioma y Cultura de la Universidad de Kyūshū, y las halagó enormemente; después entró a formar parte del proyecto”.

Sin embargo, pese a los elogios hablar con el profesor también le causó un cierto desánimo.

“Como creador de videojuegos considero fascinante la idea de destruir lo que existe y construir algo nuevo en su lugar. En el pasado rompí las convenciones de los juegos y creé algo nuevo, y ahora quiero hacer lo mismo con la gramática y crear una nueva. Por eso, que alguien pueda comprender mis ideas con facilidad sin enfadarse me ha decepcionado un poco, como si me dijeran que eso ya lo ha pensado alguien antes. Para los miembros de la élite intelectual, que se educaron con libros de texto, resultaría imposible crear una inteligencia artificial tan rara como la mía. Abrir un camino nuevo donde antes no había ninguno es más bien un trabajo para alguien como yo, del mundo del entretenimiento”.

Contra los sistemas extranjeros

¿Cree Saitō que la introducción del Amazon Echo en su versión japonesa conquistará el mercado?

“Yo soy un soldado voluntario en el ejército que defiende la industria de la inteligencia artificial contra las hordas extranjeras. Es evidente que son quienes tienen el japonés como lengua materna los que deben crear motores conversacionales en japonés. Si el motor que estamos construyendo tiene éxito no debería ser difícil adaptarlo al inglés y a otros idiomas”.

He probado la versión japonesa del Amazon Echo, pero no pude utilizarla bien; creo que habría sido más rápido y fácil buscar la información del tiempo o cambiar el volumen con el botón que hacerme entender por el altavoz.

El motor conversacional que se desarrolle con la información recopilada de Seaman no tendrá como objetivo ser útil, a diferencia de los altavoces inteligentes. Si se crea una inteligencia artificial capaz de mantener una conversación natural, ¿qué clase de implicaciones tendrá para la vida cotidiana?

Texto: Kuwahara Rika (POWER NEWS)

Imágenes: Imamura Takuma

Saitō Yutaka

Director representante de la empresa OPeNBooK, diseñador de videojuegos y presidente del Centro de Investigación de Inteligencia Artificial Seaman. Algunos de sus juegos más representativos son The Tower, Seaman: kindan no petto (Seaman: mascota prohibida), Ōdama o Aero Porter. También es autor de varios libros, como Hanbāgā wo matsu sanpun no nedan (El precio de esperar tres minutos para una hamburguesa, Gentosha) o Makkintosshu densetsu (La leyenda de Macintosh, OPeNBooK). En noviembre de 2017 se reeditó su obra de 1996 Ringo no ki no shita de - Appuru wa ika ni shite Nihon ni jōriku shita no ka (Bajo un manzano - Cómo Apple aterrizó en Japón, Kobunsha).

Imagen del encabezado: Saitō Yutaka

(Traducido al español del original en japonés)