Plus de la moitié des deepfakes sexuels impliquant des mineurs ont été créés par leurs camarades d’école

Actualités

Société Technologie- English

- 日本語

- 简体字

- 繁體字

- Français

- Español

- العربية

- Русский

Selon des données publiées par l’Agence nationale de police, plus de la moitié des cas de deepfakes sexuels visant des mineurs signalés au Japon impliquent des élèves fréquentant le même établissement scolaire que les victimes.

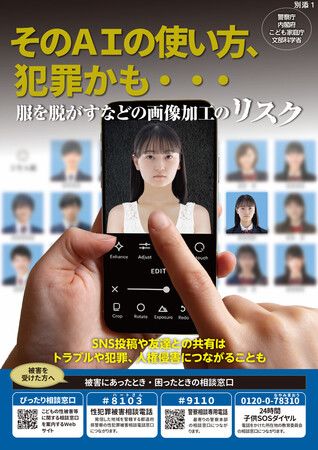

C’est la première fois que l’agence rend publiques des informations détaillées concernant des jeunes victimes de deepfakes sexuels — des images obscènes falsifiées à l’aide de l’intelligence artificielle générative ou d’autres technologies. Face à ce phénomène, la police prévoit d’élaborer des brochures de sensibilisation et de mettre en garde contre les usages abusifs de l’IA lors de conférences sur la prévention de la délinquance dans les écoles et lors d’événements similaires.

Entre janvier et septembre de cette année, la police a reçu 79 signalements concernant des deepfakes visant des mineurs de moins de 17 ans. Parmi ces cas, 41 concernaient des collégiens, 25 des lycéens et quatre des élèves du primaire.

Sur l’ensemble de la période étudiée, 53,2 % des affaires impliquaient des élèves du même établissement, qu’il s’agisse de camarades de classe ou d’élèves plus âgés.

Dans 14 cas, il a été confirmé que les images avaient été produites à l’aide d’une IA générative, et dans 2 cas, à l’aide d’applications de retouche d’images. Bien que la méthode exacte n’ait pas pu être identifiée dans les autres dossiers, les autorités estiment que la majorité des contenus ont probablement été générés par intelligence artificielle.

[Copyright The Jiji Press, Ltd.]